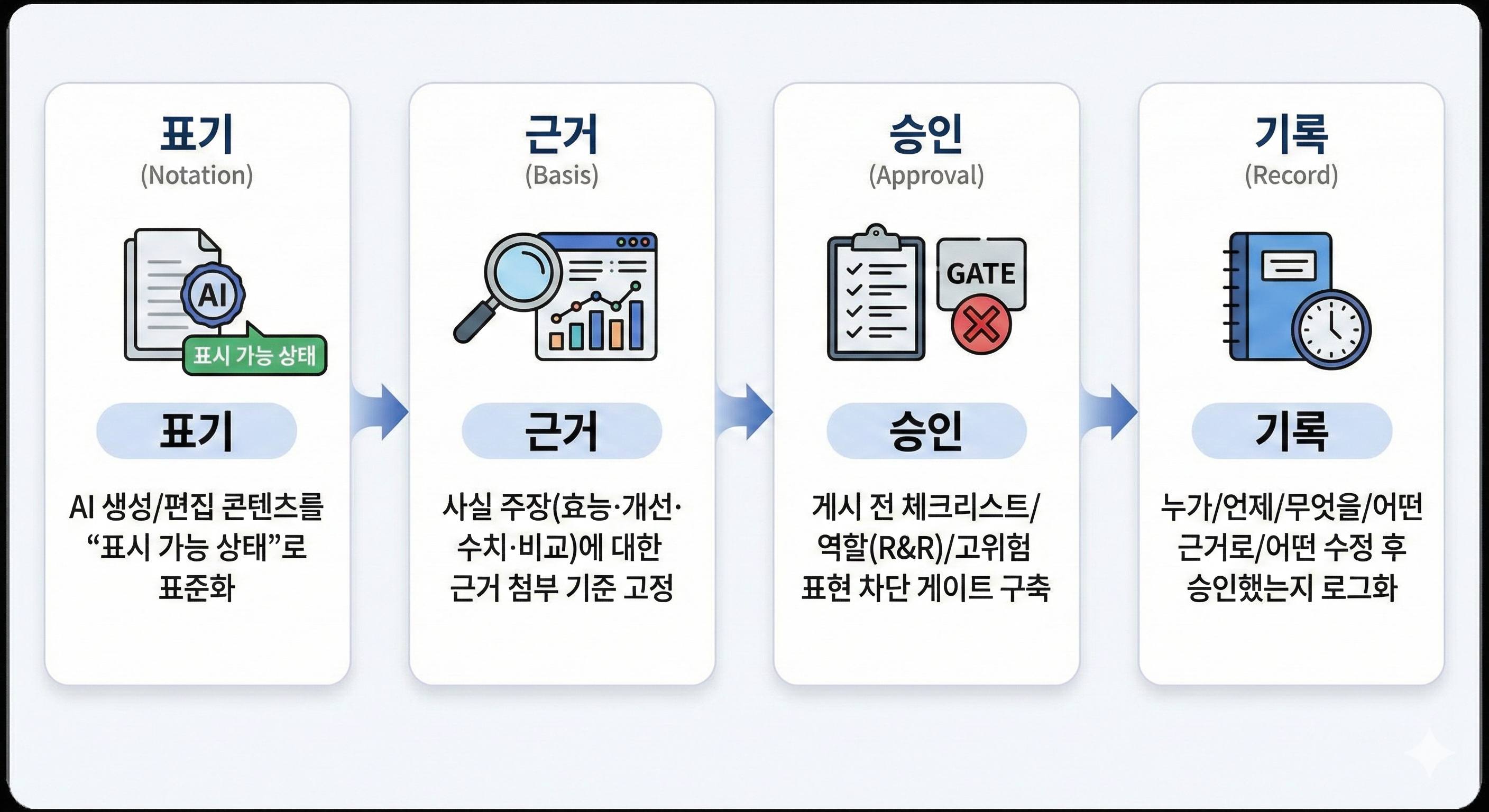

생성형 AI로 만든(또는 편집한) 광고/콘텐츠를 표기(라벨) 가능한 상태로 만들고, 외부 노출 전에 검수 리포트로 리스크를 줄이며, “누가/언제/무엇을/근거로/어떤 수정 후 승인했는지”를 기록(로그)으로 남겨 분쟁·반려·민원에도 소명 가능한 상태를 구축하는 패키지입니다.

이 패키지는 “AI를 쓰지 말자”가 아니라,

AI를 쓰더라도 문제없이 운영되게 만드는 최소요건(표시·근거·기록)을 납품하는 서비스입니다.

왜 기업이 이 패키지를 선택하나요?

AI 생성/편집 콘텐츠가 늘면, 실제로 가장 자주 생기는 문제는 이 3가지입니다.

표시 누락

AI로 만든 이미지/영상/문구가 섞였는데, 표기 기준이 없어서 외부 이슈가 생길 수 있음

검수 공백

대량 생산된 콘텐츠가 검수를 충분히 거치지 못해, 과장·오인·금지표현이 그대로 나갈 수 있음

기록 부재

문제가 생겼을 때 “누가 승인했는지, 근거는 무엇인지”가 없어 대응이 늦고 책임 공방이 커짐

이 패키지는 위 3가지를 한 번에 정리해 마케팅팀이 ‘안심하고’ 생산성을 유지할 수 있게 합니다.

이런 기업에 특히 적합합니다

-

상세페이지/배너/후기편집/영상 자막 등 콘텐츠 발행량이 많은 팀

-

대행사/외주 제작물이 많아 산출물 통제가 필요한 조직

-

기능성·개선 표현(미백/주름/진정/트러블 케어 등)을 자주 다루는 화장품 브랜드

-

플랫폼 반려/경쟁사 신고/소비자 클레임을 경험했거나 예방이 필요한 조직

-

담당자 변경이 잦아 “사람의 감”이 아니라 “기준과 문서”가 필요한 조직

화장품/식품/건기식에 적용합니다

패키지로 무엇이 달라지나요? (Before → After)

Before

AI로 만든 문구/이미지가 여기저기 섞임

검수는 담당자 경험에 의존

문제가 생기면 수정만 하고 이력은 남지 않음

After

AI 생성/편집 요소는 표기 기준에 따라 라벨 적용

외부 노출 전 **검수 리포트(위험 문장 하이라이트 + 수정안 + 근거요건)**로 리스크 사전 차단

승인·수정·근거가 로그로 기록되어, 이슈 발생 시 즉시 소명 가능

납품물(기업이 실제로 받는 것)

-

채널별 라벨링 문구 라이브러리(표준 문장 세트)

-

라벨 적용 가이드(운영 방식)

-

검수 리포트 템플릿(내부용/외부용)

-

판정 요약

-

위험 문장 하이라이트

-

안전 대체 문구 3안

-

필요한 근거 체크리스트

-

운영 조치(삭제/완화/근거요청/표현전환)

-

기록(검수 로그) 템플릿 + 운영 규칙

-

(선택) 대행사 제출물 표준(가이드/조항 문구)

-

AI 사용 여부 고지

-

라벨 적용

-

작업 로그/근거 제출

-

분쟁 시 협조 및 원본 보관

실제 운영 흐름(회사 안에서 어떻게 돌아가나)

1단계. 콘텐츠 분류

텍스트/이미지/영상 중 무엇이 AI 생성·편집인지 체크

2단계. 라벨 적용

채널별 표준 문구 중 1개를 선택해 적용(하단/설명란/자막 등)

3단계. 검수(외부 노출 전)

고위험 표현(재생/치료/흉터/염증, 즉시/확실/OO% 개선, 전후 단정 등) 여부를 중심으로 보수 판정

문제가 있으면 안전한 대체 문구 3안을 제시

4단계. 근거 연결

효능·개선·수치·기간·비교 주장은 근거 링크/파일을 연결(없으면 표현 완화)

5단계. 기록(로그) 저장

누가 승인했고, 무엇을 어떻게 수정했는지 이력과 근거를 저장

이후 동일 유형 콘텐츠 제작 시 재사용 가능

적용 범위(예시)

적용 가능 자산

상세페이지 본문/배너/썸네일/카피

SNS 카드뉴스/릴스·쇼츠/유튜브 영상 설명란·자막

후기 편집 문구/인플루언서 협업 콘텐츠 가이드

라이브커머스 자막/고지/스크립트

가상 사례 2개(기업이 왜 도입하는지)

사례 A. 화장품 브랜드(대행사 제작물 혼재)

외주 제작물이 늘면서 AI 이미지·문구가 섞였지만, 표기/근거/승인 기준이 없었습니다.

라벨 문구를 표준화하고, 검수 리포트와 로그를 적용해 “누가 승인했는지”가 남게 되면서 이슈 대응 속도가 빨라졌습니다.

사례 B. 후기/UGC 편집 중심 브랜드

후기 편집 문구가 단정형으로 바뀌거나 전후 암시가 섞여 클레임이 발생했습니다.

후기 편집용 라벨 문구와 편집 원칙, 원문-편집본-변경이력 로그를 운영해 분쟁 가능성을 낮췄습니다.

자주 묻는 질문(FAQ)

Q. 라벨링을 하면 오히려 신뢰가 떨어지지 않나요?

A. 과도한 강조가 아니라 “표시 가능 상태”를 만드는 톤으로 설계합니다. 핵심은 라벨 자체가 아니라, 라벨+검수+기록이 결합된 운영 체계입니다.

Q. AI를 조금만 써도 해야 하나요?

A. 사용량이 늘기 전 “최소 기준”을 먼저 잡는 것이 비용이 가장 적게 듭니다. 이후 규모가 커져도 동일 기준으로 확장 가능합니다.

Q. 대행사 콘텐츠에도 적용 가능한가요?

A. 가능합니다. 대행사 제출물 표준(라벨/근거/로그)을 적용하면 책임 공방을 줄일 수 있습니다.

Q. 검수 리포트는 법적 승인인가요?

A. 아닙니다. 사전 리스크 점검이며, 보수적으로 위험을 줄이는 목적의 산출물입니다.

와이에스엠경영컨설팅 윤수만 소장 (AI리스크관리/AI규제관리)